擁抱基礎設施變革,掌握 AI 兆元商機

隨著人工智慧重塑整個產業,支撐這場變革的技術基礎也必須隨之演進。

AI 有望革新人類活動的各個面向。然而,要充分釋放此一潛力,就必須面對一個基本事實:支撐傳統運算的基礎設施已無法滿足未來 AI 發展的需求。

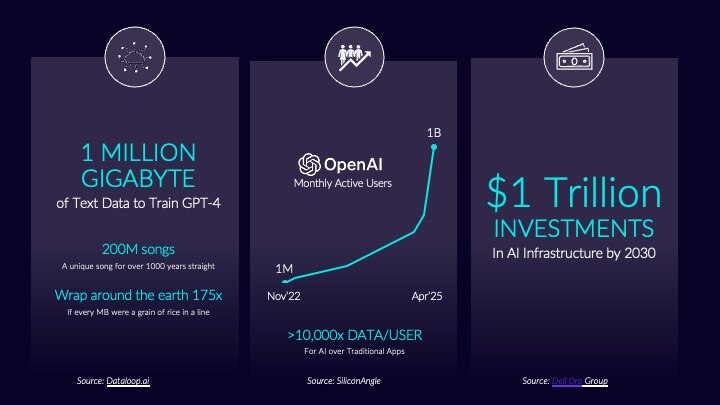

目前,產業已見證這場變革呈現出的驚人規模:

- 訓練 ChatGPT-4 已使用超過 1PB 的資料——相當於兩億首歌曲連續播放長達 1,000 年。

- OpenAI 每月為 10 億活躍使用者提供服務,每位元使用者消耗的資料量是傳統應用的一萬倍。

- 到 2030 年,這場 AI 革命將帶動超過一兆美元的基礎設施投資。

這種爆炸性的成長正將資料中心的耗電量從百萬瓦推升至十億瓦,造成的限制已無法單靠增加標準伺服器來解決。整個產業必須從根本上重新思考運算基礎設施的架構設計、建構方式和部署策略。那些能夠成功駕馭這場轉型的企業,將充分釋放 AI 的潛力;而未能及時跟進的企業,則極有可能面臨被市場淘汰的風險。

在近日於舊金山舉辦的第 62 屆設計自動化大會 (DAC) 的 SKYTalk 演講中,Arm 資深副總裁暨基礎設施事業部總經理 Mohamed Awad 分享了如何擁抱基礎設施變革,掌握 AI 兆元商機的經驗與洞察。

過往技術變革的經驗啟示

Awad 表示,要因應如此巨大的技術變革其實已有「藍圖」可循。在過去的 30 年裡,從行動運算到汽車變革,再到物聯網部署,歷次成功的技術革命都遵循著相似的發展路徑。而那些最終脫穎而出成為領導者的企業,普遍具備以下三個共同特徵:

- 追求技術領先

- 具備系統級思維

- 培育強大的生態系

此一發展模式為 AI 轉型提供重要借鏡。回顧行動裝置革命,它不僅僅是處理器速度的提升,更涉及對能源效率最佳化、軟體堆疊乃至於製造合作夥伴關係的全面革新。同樣的,汽車產業向自動駕駛和電動化轉型的過程中,也需要在晶片設計、系統架構以及生態系協作等層面採取一體化的推進策略。

Awad 表示,「要讓 AI 真正實現我們為其設定的偉大目標,所需的其實還是同樣的路徑——技術領先、從底層開始設計的系統,以及強大的生態系。」

基礎設施演進的迫切性

資料中心的演進過程充分展現產業快速適應 AI 需求的能力。2020 年之前,企業主要依賴通用伺服器,並透過 PCI 插槽增加加速器。到了 2020 年,重點轉向使用具備 GPU 之間直接連結能力的整合伺服器。2023 年,我們見證了 CPU 與 GPU 的高度整合。如今,產業正向完整的「AI 工廠」邁進——從晶片層面開始,為特定工作負載場景打造整個伺服器機櫃。

領先的科技公司正摒棄「一體適用」的通用架構思路。NVIDIA 的 Vera Rubin AI 叢集、亞馬遜網路服務 (AWS) 的 AI UltraCluster、Google 的 Cloud TPU 機櫃,以及微軟的 Azure AI 機櫃,都是針對其自身獨特需求而專門打造的客製化系統,而非通用解決方案。

Awad 解釋道,「所有領先的超大規模雲端服務供應商都在做同樣的事情。他們從晶片層開始建構高度整合的系統,根據自身的系統需求反向驅動晶片層的創新。」

此一轉變反映出整個產業達成的廣泛共識:AI 的運算需求必須依賴專為 AI 工作負載設計的基礎設施,而非在通用系統基礎上改造的解決方案。

經大規模驗證的效能表現

AWS 報告稱,過去兩年新部署的 CPU 算力中,有超過 50% 來自其搭載 Arm 架構的 Graviton 處理器。此外,包括 Amazon Redshift、Prime Day、Google 搜尋和 Microsoft Teams 在內的關鍵工作負載,如今都運行在基於 Arm Neoverse 等先進技術建構的基礎設施上,展現顯著的效能提升與能源效率最佳化。

Awad 進一步解釋,這些舉措並非出自於成本削減的考量,而是為了追求效能。企業打造客製化晶片,並非因為其成本更低,而是因為它能在特定資料中心環境下,實現通用解決方案無法達到的效能與能源效率水準。

透過協作加速創新

打造客製化晶片面臨許多挑戰,包括高昂的成本、複雜的設計以及漫長的開發週期。解決之道在於透過協作生態系來降低門檻、加速創新。像 Arm CSS (Compute Subsystems) 此類預整合的運算子系統、共用的設計資源以及經過驗證的工具流程,都能顯著縮短開發週期。

已有產業實例展現了生態系協作的潛力。部分合作專案透過在設計中使用預配置、預驗證的 CSS,使合作夥伴節省了 80 人/年的工程師投入,將開發週期從數年縮短至數月。Awad 表示,其中一個專案從啟動到製造出能夠在 128 個核心上運行 Linux 的晶片,僅用了 13 個月——對於頂尖的晶片開發而言,這樣的速度可謂相當驚人。

正在崛起的小晶片 (Chiplet) 生態系,代表產業協作的又一重大突破。像 Arm 小晶片系統架構 (Arm Chiplet System Architecture, CSA) 這樣的產業倡議正在定義通用介面與協定,許多亞太地區的合作夥伴已參與其中,共同開發標準化的運算模組,並可按需求組合應用於不同場景,進而構建更加靈活且更具成本效益的開發路徑。此外,透過 Arm 全面設計 (Arm Total Design) 等生態系專案,這類協作框架將晶圓代工廠、設計服務商、IP 供應商以及韌體合作夥伴緊密連接,以簡化整個開發流程。

軟硬體協同釋放 AI 潛力

僅靠硬體創新已無法真正釋放 AI 的潛力。要成功還需要強大的軟體生態系支撐——這背後凝聚了長達 15 年的持續投入:數百萬開發者的參與、廣泛的開源專案支援,以及成千上萬家的供應商共同打造相容的解決方案。

當今領先的 AI 基礎設施部署依靠成熟的軟體堆疊,涵蓋 Linux 發行版本、雲端原生技術、企業級 SaaS 應用以及 AI/ML 框架等。這種軟體的成熟度使得企業能夠放心地部署新的硬體架構,確信其整個技術堆疊可以無縫運行。

Awad 表示,「如果沒有軟體,硬體就沒有意義。這一點相當重要。因為當我們談論為 AI 而打造的加速器、裝置和晶片時,人們常常問我軟體方面的情況。常有新創公司來找我時表示,『我開發了這個很棒的硬體產品』。但當我問他們,『有多少人專門為它開發軟體?』時,答案往往就不具有說服力了。」

擁抱基礎設施變革

隨著 AI 持續呈指數級成長,基礎設施面臨的挑戰也越發嚴峻。企業無法僅靠增加傳統伺服器來實現擴展,他們需要的是專為 AI 工作負載最佳化的客製化系統,同時還必須具備在前所未有的規模下高效運行的能力。

能夠成功應對此一轉型的企業和技術,往往具備共同的特徵:它們透過技術領先追求突破性效能表現,採用系統級的整體思維而非著眼於個別元件的思維,並建構協作型生態系,能在加速創新的同時降低個體風險。

這場基礎設施變革既是挑戰,也是機會。那些正在著手準備——透過理解這些核心原則並建構合適的技術基礎——的企業,將更有機會掌握 AI 帶來的兆元級市場商機。而仍然固守舊有模式的企業,則有可能錯失當代最大的技術機會。

Awad 總結,「未來屬於那些已經準備好去創造它的人。」而基礎設施的變革已經啟程。

關於 Arm

Arm 是業界效能最高且最節能的運算平台,其無可比擬的應用範疇觸及全球所有連網使用者。為因應全球對運算永無止境的需求,Arm 提供先進的解決方案,使全球領先的科技公司得以釋放前所未有的 AI 體驗與功能。透過與全球最大的運算生態系及 2,200 萬名軟體開發者的共同努力,我們正在 Arm 平台上建構 AI 的未來。

所有資訊都「依目前情況」提供,且並不帶保證或代表性。此文件可以自由分享,但不得修改且必須註明出處。Arm 是 Arm Limited(或其子公司與附屬機構)的註冊商標。所有品牌或產品名稱均為所屬公司之財產。© 1995-2025 Arm Limited.